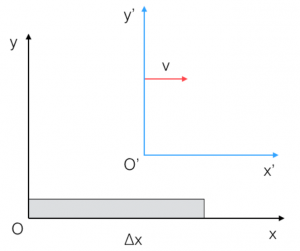

In fisica, molto spesso, per rappresentare un determinato fenomeno, si utilizza un sistema di riferimento con assi coordinati.

Ad esempio, si può utilizzare un sistema di riferimento spazio-tempo, che è quindi bidimensionale; altrimenti un sistema di riferimento con più coordinate, in base al numero di dati che si vogliono rappresentare.

Solitamente si utilizza un grafico tridimensionale $(x, y, z)$ per descrivere la posizione del corpo che si vuole studiare, e si aggiunge poi la variabile temporale t per descrivere l’istante di tempo in cui il corpo si trova in una certa posizione.

L’intera quaterna $(t, x, y, z)$ è quella che definisce l’intero evento.

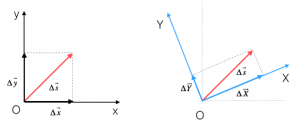

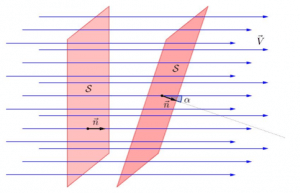

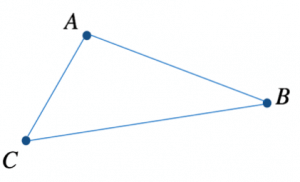

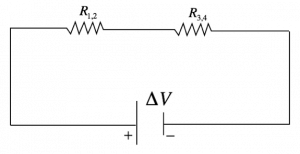

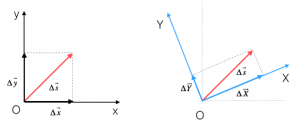

Per introdurre in concetto di intervallo invariante, consideriamo inizialmente due sistemi di riferimento bidimensionali, dei quali il primo è (x, y), il classico sistema di riferimento cartesiano, mentre il secondo $(X, Y)$ è un sistema di riferimento in cui gli assi sono ruotati di un angolo α rispetto al precedente.

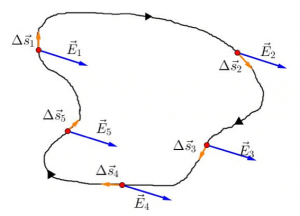

Consideriamo sugli assi dei due sistemi di riferimento rispettivamente i vettori ∆x, ∆y, ∆X, ∆Y, che descrivono, nei propri sistemi, lo stesso vettore spostamento ∆s:

In entrambi i casi, il modulo del vettore spostamento può essere determinato utilizzando il teorema di Pitagora, a partire dai suoi vettori componenti; per il primo sistema di riferimento abbiamo quindi:

$ (∆x)^2 + (∆y)^2 = (∆s)^2$

e per il secondo sistema di riferimento abbiamo:

$ (∆X)^2 + (∆Y)^2 = (∆s)^2$

Poiché il modulo del vettore spostamento è lo stesso in entrambi i casi, possiamo uguagliare le due espressioni precedenti e otteniamo:

$ (∆x)^2 + (∆y)^2 = (∆X)^2 + (∆Y)^2$

Quindi, anche se cambiamo sistema di riferimento, e anche se cambiano i vettori componenti che descrivono uno stesso vettore ∆s, la somma dei quadrati dei moduli dei suoi vettori componenti nei vari sistemi è invariante, cioè è sempre uguale.

Possiamo estendere il ragionamento al caso di un sistema tridimensionale, in cui cioè compare un terzo asse; nel primo sistema di riferimento avremo l’asse z, su cui individuiamo il vettore componente ∆z, mentre sul secondo sistema di riferimento consideriamo l’asse Z con vettore componente ∆Z.

Nell’uguaglianza, quindi, dobbiamo aggiungere anche il quadrato della componente del vettore spostamento lungo il terzo asse:

$ (∆x)^2 + (∆y)^2 + (∆z)^2 = (∆X)^2 + (∆Y)^2 + (∆Z)^2$

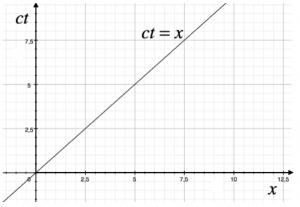

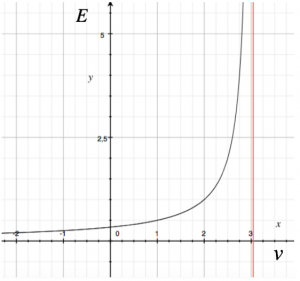

Il concetto di intervallo invariante si utilizza nell’ambito della relatività ristretta, dove però si considera anche un’intervallo di tempo ∆t per descrivere un determinato fenomeno.

Si definisce, quindi, il quadrato dell’intervallo invariante per la relatività ristretta la seguente quantità:

$ (∆σ)^2 = (c * ∆t)^2 – (∆x)^2 – (∆y)^2 – (∆z)^2 $

Dove le quantità ∆x, ∆y, ∆z rappresentano gli incrementi di coordinate che separano due eventi distinti.

L’intervallo invariante, quindi, è dato dalla radice quadrata dell’espressione precedente:

$∆σ = sqrt((c * ∆t)^2 – (∆x)^2 – (∆y)^2 – (∆z)^2)$

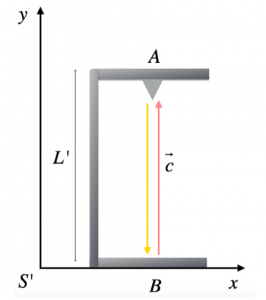

Esaminiamo il caso particolare in cui il sistema di riferimento considerato è solidale con il fenomeno; di conseguenza, le coordinate che rappresentano l’inizio del fenomeno e la sua fine hanno le stesse coordinate spaziali, e quindi gli incrementi ∆x, ∆y e ∆z sono nulli. L’intervallo di tempo ∆t coincide proprio con il tempo proprio del fenomeno, e quindi la formula precedente assume una semplice espressione, e l’intervallo invariante è dato dal prodotto dell’intervallo di tempo per la velocità:

$∆σ = sqrt((c * ∆t)^2 – (∆x)^2 – (∆y)^2 – (∆z)^2) = sqrt((c * ∆t)^2 – (0)^2 – (0)^2 – (0)^2) = sqrt((c * ∆t)^2 ) = c * ∆t$

Esercizio

Consideriamo un’astronave che viaggia verso una stella distante 25 anni-luce dal Sole; sapendo che la durata del viaggio prevista è di circa 28 anni, calcolare la velocità a cui si muove l’astronave e la durata del viaggio misurata dall’astronave.

Conoscendo la distanza della stella dal Sole, e il tempo impiegato dall’astronave per raggiungerla, possiamo facilmente calcolare la velocità a cui viaggia l’astronave:

$ v = s/t = frac(25 al)(28 a) = 0,89 (al)/(a) = 0,89 c$

Per il secondo quesito, consideriamo il sistema di riferimento dell’astronave: rispetto ad esso, la partenza e l’arrivo avvengono nello stesso luogo, quindi la durata del viaggio rispetto all’astronave sarà uguale al tempo proprio.

Se consideriamo l’asse x quello su cui giace la retta che passa per il Sole e la stella, l’incremento ∆x corrisponde alla distanza della stella dal Sole.

Dall’equazione dell’intervallo invariante, sappiamo che nei sistemi di riferimento dell’astronave e della Terra, l’intervallo ∆s è lo stesso. Nel sistema di riferimento dell’astronave l’intervallo invariante è dato dalla formula:

$∆σ = c * ∆τ$

dove τ indica il tempo proprio;

mentre rispetto alla Terra si ha la seguente formula:

$∆σ = sqrt((c * ∆t)^2- (∆x)^2) $

dove ∆t indica il tempo in anni impiegato dalla navicella a compiere il tragitto, mentre ∆x è la distanza percorsa.

Uguagliando le due espressioni possiamo ricavare il valore del tempo proprio:

$ ∆τ = frac( sqrt((c * ∆t)^2- (∆x)^2))(c)$

Sostituiamo i valori numerici:

$ ∆τ = frac( sqrt((c * ∆t)^2- (∆x)^2))(c) = frac( sqrt((1 * 28)^2- (25)^2))(1) = 12,6 a $

Potrebbero Interessarti

Video Lezioni: Relatività

Appunti: La velocità della luce

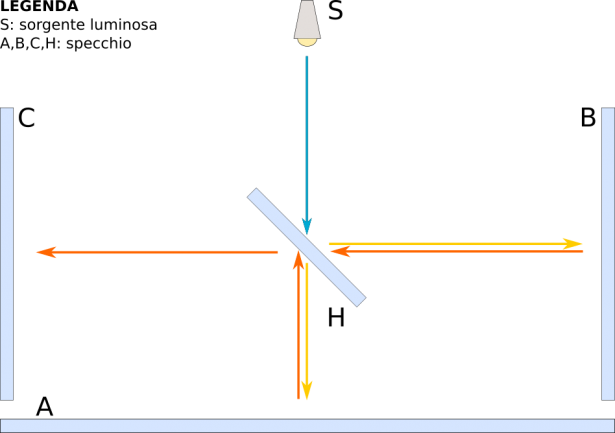

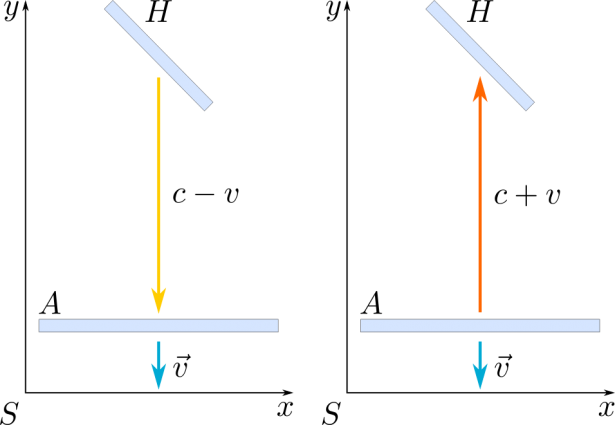

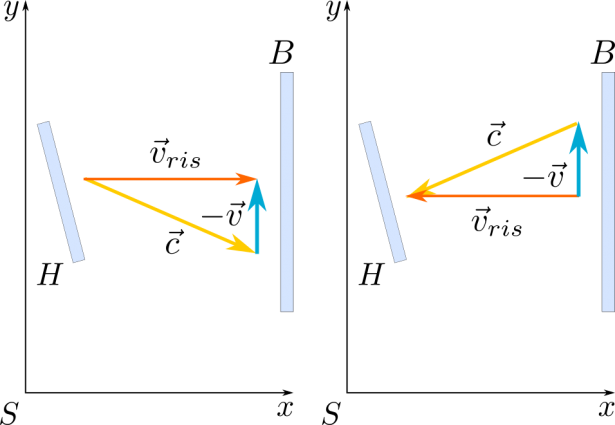

Appunti: L’esperimento di Michelson-Morley

Appunti: La relatività ristretta

Appunti: La dilatazione del tempo

Appunti: La contrazione delle lunghezze

Appunti: Le trasformazioni di Lorentz

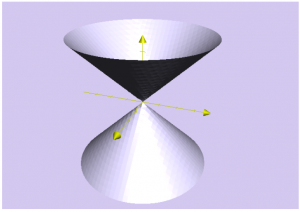

Appunti: Lo spazio-tempo di Minkowski

Appunti: Equivalenza massa-energia

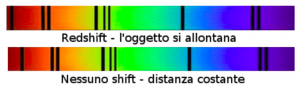

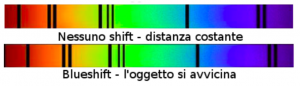

Appunti: L’effetto doppler relativistico

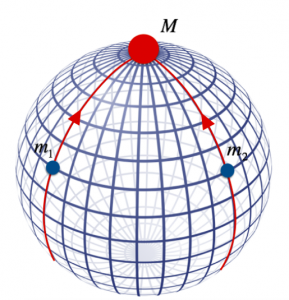

Appunti: La relatività generale

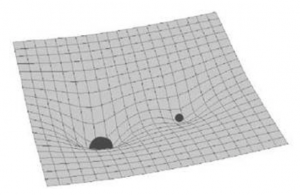

Appunti: La curvatura dello spazio-tempo

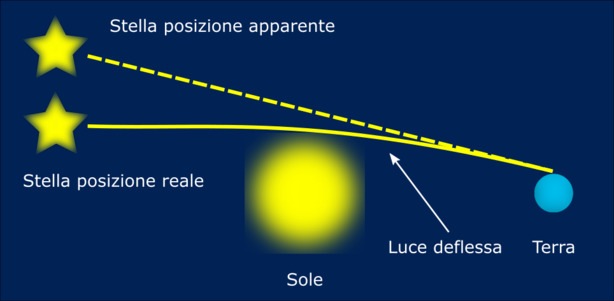

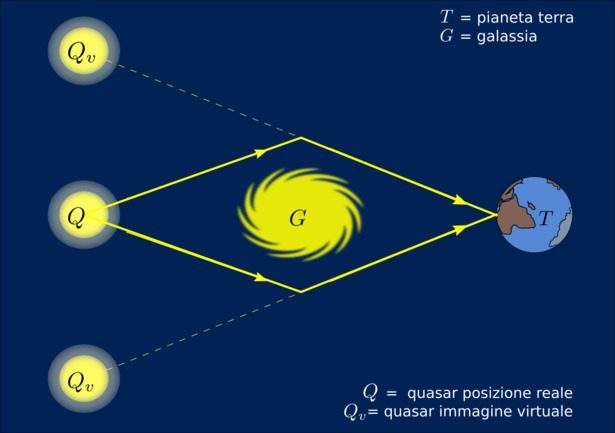

Appunti: La deflessione gravitazionale della luce